Obsah

- 1 Apple oznámil nové algoritmy pro ověřování uživatelských fotografií a ochranu dětí

- 2 Apple potvrdil, že zkontroluje naše fotografie. A také zprávy a vyhledávací dotazy

- 3 Jak Apple ověřuje naše fotografie

- 4 Čte Apple naše zprávy?

- 5 Jak se Siri změní v iOS 15

- 6 Apple odhalil počáteční spouštěcí práh pro uživatelský systém skenování fotografií – 30 zakázaných snímků

Apple oznámil nové algoritmy pro ověřování uživatelských fotografií a ochranu dětí

Apple potvrdil, že zkontroluje naše fotografie. A také zprávy a vyhledávací dotazy

Včera mnohá média vytrubovala zprávu o záměru Applu začít kontrolovat fotografie uživatelů přímo na jejich iPhonu, zda nezneužívají děti. To přirozeně vyvolalo u většiny uživatelů překvapení, ne-li rozhořčení. Ostatně, jakkoli negativně nahlížíme na šikanu dětí, stále je prohrabávání osobních fotografií takovým porušením pravidel soukromí, že si snad ani nelze nic víc představit. Cupertino však nemělo v úmyslu hrabat se v našich iPhonech ručně a model ochrany dětí stavělo na trochu jiném principu.

Apple vaše fotografie skutečně analyzuje. Pravda, pouze z iCloud Photos

V noci z 5. na 6. srpna Apple oznámil tři nové iniciativy, které mají zajistit ochranu mladých uživatelů iPhonů, iPadů a Maců. Jsou zaměřeny na odhalování materiálů obsahujících známky zneužívání dětí a omezují funkce vyhledávání ve vztahu k zakázanému obsahu. Tyto mechanismy vstoupí v platnost koncem tohoto roku s vydáním iOS 15.

Jak Apple ověřuje naše fotografie

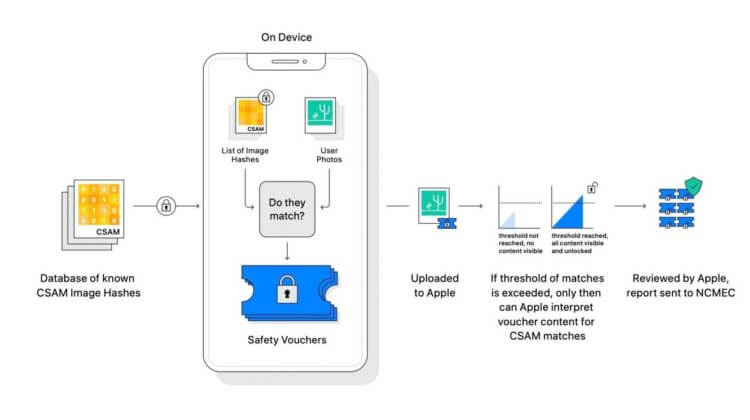

První iniciativa se podle očekávání týká fotografií. Zahrnuje zkoumání obrázků z iCloud Photos, zda nevykazují známky zneužívání dětí. Společnost vyvinula speciální analytickou techniku, která umožňuje provádět veškeré výpočty přímo na zařízení, čímž se eliminuje lidský faktor. To znamená, že skuteční lidé neinteragují s fotografiemi.

Analyzovány budou pouze fotografie nahrané do cloudu. Analýza však bude provedena pouze na zařízení

K tomu slouží speciální nástroje, které jsou založeny na práci neuronových sítí a strojovém učení. Sleduje znaky charakteristické pro explicitní fotografie zahrnující nezletilé. Pokud Apple odhalí fotografie se známkami zneužívání dětí, předá tyto informace spolu se všemi údaji o majiteli příslušným úřadům.

Na jednu stranu je dobře, že Apple z analýzy fotografií vyloučil lidský faktor. Můžete tak zaručit, že vaše fotografie nikdo z firmy neuvidí. Ale na druhou stranu se Apple bude v našich smartphonech stále hrabat, byť poněkud nepřímo. A to není nejlepší scénář pro boj o soukromí. To však neplatí pro obrázky uložené zcela lokálně.

Čte Apple naše zprávy?

Apple zabuduje podobné nástroje do aplikace Zprávy. Zde bude hrát roli jakéhosi firewallu, blokujícího přístup k obsahu, který je pro dětské oči nežádoucí. Podstatou této inovace je, že pokud se nyní dítě pokusí odeslat nebo přijmout fotografii s explicitním obsahem, uvidí pouze rozmazaný obrázek a varování.

Apple nebude číst zprávy od nezletilých uživatelů, ale dá k tomu příležitost jejich rodičům. I když jen částečné

Toto varování bude uvádět, že obrázek může být citlivý. Navzdory tomu na něj dítě bude moci kliknout pro zobrazení, ale uvidí další varování, že se o této akci dozvědí další členové iCloud Family, se kterými je spojeno jeho vlastní zařízení. Toto pravidlo bude platit pro děti do 13 let.

Apple se nestará o vaši bezpečnost nebo proč iOS 14 zakázal sledování v aplikaci

Apple vysvětluje, že Messages bude používat stejné neuronové sítě a technologie strojového učení, které detekují fotografie zneužívání dětí na iPhonech uživatelů. Budou také fungovat přísně na zařízení, ale pouze zpočátku bude firewall fungovat pouze pro účty iCloud vytvořené v USA. Další země budou připojeny později.

Jak se Siri změní v iOS 15

iOS 15 bude obsahovat vylepšené funkce Siri a vyhledávání, které pomohou dětem a jejich rodičům cítit se bezpečněji při používání internetu. Nově se například uživatelé budou moci zeptat hlasového asistenta, kde si stěžovat na zneužívání dětí nebo vykořisťování nezletilých, a Siri tyto informace okamžitě poskytne.

Siri nemůže omezit výsledky vyhledávání, ale snaží se o to

Kromě toho bude Siri varovat před nevhodným obsahem, který obsahuje násilí nebo vykořisťování nezletilých. Pokud požádáte hlasového asistenta, aby něco takového vyhledal na internetu, upozorní vás, že tyto informace mohou být nebezpečné. Siri proto místo nich nabídne zdroje, které pomáhají lidem trpícím přitažlivostí k takovým tématům.

Je pravda, že Siri nebude moci omezit výsledky vyhledávání. Jde o to, že z toho nemůže vyloučit určité odkazy a nechat jiné, které se jí zdají přijatelné. Zde by tedy Applu jednoznačně prospěl vlastní vyhledávač, kde by mohl rozhodovat o tom, jaký obsah lze sdílet s uživateli různého věku a jaký absolutně není povolen.

Apple odhalil počáteční spouštěcí práh pro uživatelský systém skenování fotografií – 30 zakázaných snímků

Podle agentury Reuters Apple odhalil počáteční spouštěcí práh pro svůj systém skenování uživatelských fotografií pro materiály týkající se sexuálního zneužívání dětí odeslané na iCloud. Tato funkce zabezpečení dětí přichází na iOS 15.

Uživatelský účet bude považován za podezřelý, pokud jeho smartphone obsahuje 30 nebo více hashových shod s obrázky zneužívání dětí, včetně dětské pornografie, s FBI a Národním střediskem pro pohřešované a zneužívané děti. Do těchto databází lze přidat i data z veřejných organizací, ale po dohodě s Applem.

Tyto informace budou následně ověřeny zaměstnanci Applu a předány orgánům činným v trestním řízení. Pokud se potvrdí přítomnost zakázaného obsahu, společnost zablokuje uživatelský účet s třiceti a více zakázanými rámy.

Zaměstnanci společnosti a vládní úředníci nebudou mít během vyšetřování přístup k celé knihovně fotografií uživatele na chytrém telefonu. V případě nesouhlasu s blokací bude moci uživatel podat odvolání podle pravidel iCloudu. Během několika dní jej ručně zkontrolují specialisté Applu.

Apple ujistil, že pokud nenahrajete fotografie do cloudové služby iCloud a vypnete funkci iCloud Photos, sledovací systém nebude na zařízení uživatele nic analyzovat. Společnost také vysvětlila, že nová funkce je základní součástí iOS a nelze ji měnit v závislosti na zemi, ve které se iPhone používá – všichni uživatelé na světě budou mít stejné podmínky pro skenování svých obrázků.

Apple agentuře Reuters objasnil, že algoritmus pro analýzu hash fotografií a účetní systém se stále dokončuje. Po spuštění systému do hromadného používání může být počet zakázaných rámců, které mají společnost upozornit na akce uživatelů, snížen a bude nižší než 30.

Začátkem srpna média oznámila, že Apple začne skenovat iPhony a vyhledávat fotografie zneužívání dětí. Apple uznal, že existuje problém s tím, jak uživatelé tuto inovaci přijali. Společnost říká, že nový systém pro analýzu fotografií na iPhonu a vyhledávání nelegálních a zakázaných obrázků je součástí „důležité mise“, která má zajistit bezpečnost dětí a zároveň zachovat hluboký závazek společnosti Apple k ochraně soukromí uživatelů.

6. srpna vyzvali vývojáři, odborníci na informační bezpečnost, kryptografové, výzkumníci, vědci, právníci a každodenní uživatelé z celého světa v otevřeném dopise Apple, aby upustil od plánů skenovat veškerý osobní obsah na zařízeních uživatelů. Domnívají se, že to podkopává soukromí uživatelů v ekosystému společnosti a mechanismus end-to-end šifrovacího systému. Otevřený dopis již na GitHubu podepsalo více než 8 tisíc jednotlivců a organizací, včetně Freedom of the Press Foundation, New York Public Library a bývalého důstojníka CIA Edwarda Snowdena.

Bývalý bezpečnostní šéf Facebooku Alex Stamos komentoval situaci ohledně politiky Applu a řekl, že v této situaci neexistují jednoduché odpovědi. Stamos vyzývá k podrobnější diskusi na obou stranách – příznivcích inovace, podle nichž jde o skvělý krok, i odpůrcích, pro které je to naprosto nepřijatelná situace.

- jablko

- skenování obrazu

- iCloud